英伟达H100供给缺口:43万张(组图)

作者老K 编辑硬AI

最近,GPU Utils更新了关于英伟达H100显卡供需现状的分析文章,里面主要透露、总结了当前影响GPU的主流厂商拥有显卡的数量以及对显卡的需求量。

作者表示,考虑到训练和推理性能,以及推理方面性价比,H100是当下最受欢迎的GPU(具体为8-GPU HGX H100 SXM)。

GPU Utils认为,保守估计,H100的供给缺口达到43万张。

影响GPU供需的「头部玩家」

本文简要总结了一下文章核心数据供大家参考:

● OpenAI、特斯拉等厂商对GPU的需求量

● OpenAI、特斯拉等厂商拥有的GPU数量

● 供应瓶颈、其他核心数据

谁需要?

需要 1000 张以上的 H100 或 A100的公司:

1、训练 LLM 的创业公司:

OpenAI (通过Azure)、Anthropic、Inflection (通过Azure和CoreWeave)、 Mistral AI;

2、云服务提供商:

三大云巨头:Azure、Google Cloud、AWS;

另一个公有云:Oracle;

更大的私有云:例如 CoreWeave、Lambda;

3、其他大公司:

特斯拉;

需要100张以上的H100 或 A100的公司:

对开源模型进行大量微调的初创公司。

要多少?

1、OpenAI可能需要5万张,Inflection要2.2万张,Meta需要2.5万张(也有人说 Meta 想要10万张或更多)

2、大型云厂商,每家可能需要3万张(Azure、Google Cloud、AWS、Oracle)

3、Lambda 和 CoreWeave 以及其他私有云可能总共需要10万张

4、Anthropic、Helsing、Mistral、Character,每家可能要1万张;

到这里,需求量就已经达到了约「43.2万张」H100,以每块约3.5万美元计算,GPU的价值约为「150亿美元」。

而这,还不包括像字节(TikTok)、百度、腾讯这样需要大量H800的中国公司,以及一些需求正盛的金融公司:

如Jane Street、JP Morgan、Two Sigma、Citadel等金融巨头,正从数百台A100或H100开始部署,逐步增加至数千张 A/H100。

有多少?

OpenAI、特斯拉等厂商拥有的GPU数量。

大公司

1、GPT-4可能在1w-2.5w张A100上进行的训练,根据马斯克的说法,GPT-5可能需要3w-5w张H100;

2、Meta约有2.1万张A100;

3、Tesla约有7000张A100;

4、Stability AI约有5000张A100;

云厂商

1、GPC约有2.5万块H100;Azure可能有1-4万块H100,Oracle可能类似;(其中,Azure 的大部分 GPU 都将流向OpenAI。)

2、CoreWeavw有3.5-4万块H100——不是现货,而是预定的;

其他数据

1、Falcon-40B,在384个A100上进行训练;

2、Inflection,在其GPT-3.5等效模型中使用了3500个H100;

谁供应?

1、瓶颈在哪?

供应;

2、谁在制造H100?

台积电;

3、三星、英特尔可以代工吗?

至少现在不行。目前,H100s和其他5nm英伟达GPU均由台积电代工。

过去,英伟达曾尝试让三星代工,但后来换掉。未来,英伟达当然有可能与英特尔、三星合作,但短期无法缓解供给紧张。

其他核心数据

1、人们需要哪些GPU?

主要是H100,具体来说,是8-GPU HGX H100 SXM,因其在训练和推理最快,且在推理方面性价比最高。

训练方面,企业主要关注内存带宽、FLOPS、缓存和缓存延迟、FP8计算等附加功能、计算性能(与Cuda核心数量相关)、互连速度(如InfiniBand)等,H100 比A100更受青睐,部分原因是缓存延迟较低和FP8计算等。

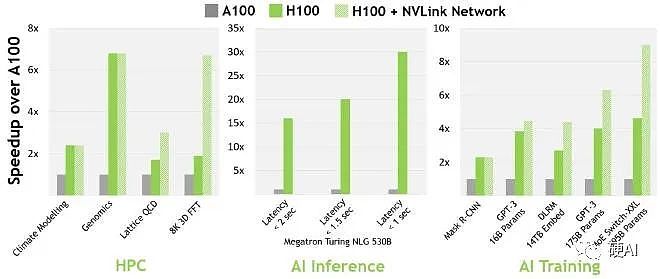

2、H100 比 A100 快多少?

16-bit推理速度提高约3.5倍,16-bit训练速度提高约2.3倍。

3、为啥不买AMD?

某私有云CEO:

从理论上讲,一家公司可以购买一堆AMD的GPU,但要让一切正常运转需要时间。

开发时间(即使只要2个月),也可能就意味着比竞争对手更晚进入市场。所以,现在英伟达的护城河是CUDA。

另一家私有云CEO:

没有人愿意冒险部署 10,000个 AMD GPU,这几乎是 3 亿美元的投资。

4、目前大家在使用什么云?

a. OpenAI: Azure

b. Inflection: Azure and CoreWeave

c. Anthropic: AWS and Google Cloud

d. Cohere: AWS

e. Hugging Face: AWS

f. Stability AI: AWS

g. Character.ai: Google Cloud

h. X.ai: Oracle

i. Nvidia: Azure

本文主要参考(原文链接):

https://gpus.llm-utils.org/nvidia-h100-gpus-supply-and-demand/#which-gpus-do-people-need

本文不构成个人投资建议,不代表平台观点,市场有风险,投资需谨慎,请独立判断和决策。

+61

+61 +86

+86 +886

+886 +852

+852 +853

+853 +64

+64